世界各国で実用化に向けた取り組みが進められている自動運転。Waymoをはじめとする先行組はグローバル路線にかじを切り、事業拡大フェーズに突入した。日本国内でもレベル4サービスが始まり、実証も盛んに行われている。

自動運転時代が本格的に幕を開けようとしている印象だが、母数の増加に伴い自動運転車が絡む事故も増加している。日本、そして世界ではどのような事故が発生しているのか、自動運転車の事故事例をまとめてみた。

・2026年3月11日:事故の最新データを追記

・2024年1月12日:日本初レベル4の事故の事故原因について追記

・2023年11月6日:Cruiseの事故と日本初レベル4の事故について追記

・2018年4月29日:記事初稿を公開

記事の目次

- ■海外での事例

- 2016年2月14日:Googleの自動運転車が路線バスと衝突

- 2016年5月7日:テスラ車で部分自動運転モード中に死亡事故

- 2018年3月18日:ウーバー車が自動運転中に歩行者と死亡事故

- 2018年3月23日:テスラEVが2件目の自動運転モード中の死亡事故

- 2023年10月2日:Cruiseが女性を下敷きにする事故

- 2023年11月27日:テスラ車が道路脇で交通整理中の人に衝突

- 2023年12月11日:Waymoの自動運転タクシーが牽引車両に接触

- 2024年2月6日:Waymoの自動運転タクシーが自転車と接触

- 2024年4月19日:FSD作動中二輪車に追突

- 2024年5月21日:Waymoの自動運転タクシーが電柱に衝突

- 2024年7月7日:百度の自動運転タクシーと電動バイクが衝突

- 2024年12月27日:自動運転車と配送ロボットが交差点で衝突

- 2025年1月19日:Waymo車が多重事故に巻き込まれ1人死亡

- 2025年4月8日:Zoox車が乗用車と衝突

- 2025年5月8日:交差点でZoox車がオートバイと接触

- 2025年6月:テスラのロボタクシーが駐車場で接触

- 2025年7月30日:Waymoの自動運転タクシー同士が衝突

- 2025年8月6日:Baiduの自動運転タクシーが工事現場の穴に落下

- 2024年9月10日:Avrideの自動配送ロボットが自転車と衝突

- 2025年6月21日:香港国際空港で自動運転バス同士が衝突する事故

- 2025年9月14日:Waymo車に追突したオートバイドライバーが死亡

- 2025年12月6日:ハローの自動運転タクシーが重傷事故

- 2026年1月23日:Waymoの自動運転タクシーが児童と接触

- ■国内での事例

- 2019年8月26日:名古屋大学が所有する「ゆっくり自動運転」車両が接触事故

- 2020年3月10日:BOLDLYの自動運転バスが都内で物損事故

- 2020年8月30日:産総研の実証実験で接触事案、運転手の判断ミスが要因

- 2020年12月14日:再起動忘れが原因で自動運転バスがガードレールに接触

- 2021年8月26日:東京五輪の選手村でe-Paletteが接触事故

- 2023年1月11日:大津市内で乗客が座席から滑り落ちる事故

- 2023年10月29日:「日本初のレベル4」で接触事故

- 2023年11月25日:福岡市内のロータリーで自動運転バスとタクシーが接触

- 2024年1月17日:常滑市で自動運転バスがラバーポールに接触

- 2024年3月7日:千葉県横芝光町では手動運転中に遮断機に接触

- 2024年3月27日:岐阜市で自動運転バスと路線バスが接触

- 2024年6月11日/8月20日:弥彦村では物損事故が2回発生

- 2024年10月10日:中津川市内を走行中の自動運転バスが停車車両のサイドミラーに接触

- 2025年4月28日:万博駐車場待機場で回送中のシャトルバスが接触事故

- 2025年1月30日:熊本市でも自動運転バスに路線バスが接触

- 2025年3月6日:森之宮・京橋周遊バスが歩車道安全柵に接触

- 2025年7月21日:舞洲万博P&Rシャトルバスが縁石に接触

- ■カリフォルニア州における事故件数

- ■【まとめ】さまざまな事案・事故が表面化

- ■関連FAQ

■海外での事例

2016年2月14日:Googleの自動運転車が路線バスと衝突

2016年2月、アメリカのカリフォルニア州マウンテンビューの公道で、米グーグルが開発中の自動運転車が路線バスと接触する事故を起こした。カリフォルニア州には米グーグル本社があり、グーグルのお膝元で起きた事故とも言える。

事故を起こした開発中車両のベース車種は、トヨタの多目的スポーツ車(SUV)「レクサス」のRX450h。路肩の砂袋を検知したことによって自動運転車は一時停止し、その砂袋を避けて前進するために左方向に車両を動かしたとき、後ろから走行してきたバス車両の側面にぶつかったという。

カリフォルニア州の発表などによれば、グーグル側の自動運転車は時速にして3キロ以下、後ろから走行してきたバスは時速24キロだった。自動運転車の運転手にもバスの乗客15人にもけがはなかった。

グーグルは当時、2017〜20年の実用化を目指して事故を起こした車両を開発していた。グーグル側は自動運転車側の過失を認めており、事故防止に向けてソフトウェアを交換する方針などを明らかにした。グーグルは過去にも自動運転車で事故を起こしていたが、過去の事故ではもらい事故や運転手の判断ミスによるものだった。

2016年5月7日:テスラ車で部分自動運転モード中に死亡事故

電気自動車(EV)メーカーの米テスラモーターズの電気自動車「モデルS」が、2016年5月に死亡事故を起こしている。この事故では自動運転モードで米フロリダ州のハイウェイを走行していた車両が大型トレーラーに衝突し、運転していたドライバーが死亡したというものだ。

アメリカ国家運輸安全委員会(NTSB)の報告などによると、信号のない交差点で白いトレーラートラックの下に潜り込むような状態で車両が衝突したという。テスラモーターズによれば、日差しが強さやトレーラーの白い色が要因となり、自動運転のシステム側がトレーラーを「物体」として認識できなかったようだ。

国家運輸安全委員会によれば、ドライバーは事故当時は「部分的な自動運転システム」を稼働させて走行していたようだ。しかし、実際には手を添えていなければいけなかった37分間のうち、ドライバーは25秒間しかハンドルを手で触っていなかったことが明らかになっている。システム側はドライバーに対しても、ハンドルを握るよう警告を7回出していたという。

テスラはその後、2016年9月に警告にドライバーが反応しなかった場合は自動運転機能を使用不可にするなどの仕様変更を発表している。また国家運輸安全委員会は、車自体には欠陥がなかったと結論づけた。

【参考】アメリカの死亡事故とは単純比較できないが、日本の国土交通省自動車局は2018年3月に自動運転における損害賠償責任に関する研究会の「報告書」を取りまとめているので参照してみてほしい。自動運転モード中の事故の損害賠償をどう考えるかなどに触れられている。

2018年3月18日:ウーバー車が自動運転中に歩行者と死亡事故

アメリカのライドシェア最大手であるウーバーテクノロジーズ社の自動運転車が2018年3月18日、自転車を押しながら車道を渡っていた49歳の歩行者を時速約64キロではねて死亡させる事故をアリゾナ州で起こした。

事故は自動運転車が自動運転システムを稼働させていたときに発生した。当時は運転席には自動運転システムの稼働状況を監督する「人」も同乗していた。この事故を受け、ウーバーテクノロジーズ社は北米4都市の公道での走行試験を中断した(その後、2018年12月に実証実験を再開している)。

この死亡事故は、自動運転において世界で初めて歩行者を死亡させた事故と位置付けられている。この事故でウーバーテクノロジーズ社と死亡した女性の遺族はその後和解したものの、自動運転の安全性に対する厳しい目も世論から向けられたと言える。

この死亡事故に関しては、米道路安全保険協会(IIHS)が2018年10月、ベース車両に使われていたボルボ社の安全システムが解除されていなければ事故を回避できた可能性がある、という見解を示している。

ウーバーは自社の自動運転システム自体も自動ブレーキ機能を備えていることから、事故時はボルボの自動ブレーキ機能を無効にしていたことを明らかにしている。その理由については「車両の動作が不安定になることを防ぐため」と説明された。

また、運転手が事故発生直前に携帯電話でテレビ番組を視聴していたことなども明らかになっている。

【参考】関連記事としては「ウーバーの自動運転車死亡事故、車両の自動ブレーキ機能オンで防げた可能性 アメリカ道路安全保険協会が見解」も参照。

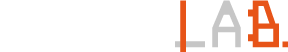

2018年3月23日:テスラEVが2件目の自動運転モード中の死亡事故

2018年3月23日、ウーバーテクノロジーズ社の車両が死亡事故を起こしてから1週間が経たない間に、アメリカの電気自動車(EV)メーカーであるテスラの電気自動車「モデルX」が米西部カリフォルニア州の高速道路で衝突事故を起こした。

事故では車両が高速道路の中央分離帯に衝突し、運転していた38歳の男性が死亡した。その後の調べによれば、事故当時は部分的な自動運転機能が作動しており、車線の逸脱や車間距離の保持がシステム側によって行われていたという。

だが事故後に明らかになった車両の記録データでは、事故の6秒前にシステム側が運転手に対してハンドルを握るように、警告を発していたようだ。事故発生までの間、死亡した男性がハンドルを握ることは無かったようだ。

テスラの自動運転モード中の死亡事故は2016年5月に続いて2度目。2018年3月にウーバーテクノロジーズとテスラの立て続けに起きた死亡事故は、そのほかのメーカーの自動運転車の実証実験などにも大きな影響を与えるニュースとなった。

【参考】関連記事としては「テスラの半自動運転死亡事故、原因「視線監視機能の不備にも」 米運輸安全委が発表」も参照。

2023年10月2日:Cruiseが女性を下敷きにする事故

2023年10月2日夜、GM傘下で自動運転タクシーを展開するCruiseの車両が米カリフォルニア州サンフランシスコのダウンタウンにおいて、他の車両にひき逃げされた女性を下敷きにする事故を起こした。事故直後は女性は命に関わる重傷と報じられている。

事故当時の映像などによれば、女性は別の車両に衝突してボンネットに乗り上げたあと、ボンネットから落下する形で道路にたたきつけられた。落下した場所はCruiseの自動運転車のすぐ前で、自動運転システムが急ブレーキをかけたが間に合わなかった。地元消防局は「自動運転車による重傷事故は初めて」とした。

Cruiseに関してはこの事故の前に、救急車両の進行を妨げるトラブルなどが頻発しており、事態を重く見たカリフォルニア州道路管理局(DMV)と同州公共事業委員会(CPUC)が、Cruiseの営業停止と無人走行試験許可を即時停止とした。

【参考】関連記事としては「GMの自動運転車、ひき逃げされた女性を下敷きに 無人走行中に避けきれず」も参照。

【参考】関連記事としては「営業停止に至ったGMの自動運転タクシー、「事故率は人間以下」は嘘だった?」も参照。

2023年11月27日:テスラ車が道路脇で交通整理中の人に衝突

2023年11月、FSD作動中による初の歩行者死亡事故がアリゾナ州で発生した。高速道路で衝突事故を起こしたクルマの交通整理を行っていた後続車両の女性に衝突したのだ。

事故現場付近では、先行車両が減速したり停止したりする中、テスラ車は減速せず時速65マイル(約105キロ)で迫ってきたという。女性は路肩に立ち、危険を知らせるため安全ベストのようなものを振り回していたというが、そこにテスラ車が突っ込んだという。

2023年12月11日:Waymoの自動運転タクシーが牽引車両に接触

アリゾナ州フェニックスでWaymoの自動運転タクシーが走行中、前方に不適切な方法で牽引されていたピックアップトラックと衝突した。ピックアップトラックは後ろ向きで牽引されていたという。

接触後、ピックアップトラックは中央右左折車線と車線を横切るように傾き続けたが、その後もレッカー車は停止せず走行し続け、数分後には別のWaymo車が同じように牽引されていた同じピックアップトラックと接触した。

牽引されるピックアップトラックとレッカー車の組み合わせの向きが常に一致しなかったため、その動きを誤って予測したことが原因としている。事件後、Waymoは自主リコールし、ソフトウェアを改善した。

【参考】Waymoの接触事案については「Google、事故後に自動運転ソフトを自主リコール 違法状態の牽引車両と接触」も参照。

2024年2月6日:Waymoの自動運転タクシーが自転車と接触

Waymoの自動運転タクシーがサンフランシスコを走行中、自転車と接触する事故が発生した。

Waymo車が乗客を乗せて走行中、交差点に差し掛かって左折しようとしたところ、対向側からトラックが来たためWaymo車は一旦停止し、トラックをやり過ごした。トラック通過後、左折を開始したところ、死角にいた自転車に気付くのが遅れて接触した。

事故は軽微だったようで、自転車はそのまま立ち去ったためWaymoが自主的に通報した。

2024年4月19日:FSD作動中二輪車に追突

FSDによる死亡事故は、2024年4月にワシントン州シアトルでも発生している。前走する二輪車に追突し、はね飛ばされたバイクの運転手はテスラ車の下敷きになり死亡した。テスラのドライバーはFSDを作動して携帯電話を見ていたという。

2024年5月21日:Waymoの自動運転タクシーが電柱に衝突

Waymoの自動運転タクシーがアリゾナ州フェニックスの公道を走行中、木製の電柱に衝突する事故が発生した。車両はドライバーレスで乗客はいなかった。乗客を乗せるためにクルマを停車させていたところ、低速で電柱に衝突したという。

ポール状のものの認知に欠陥があるとして、Waymoは全自動運転車両672台を自主リコールし、ソフトウェアアップデートとマッピングの強化を図った。

【参考】Waymo車の電柱衝突については「Googleの自動運転、全672台がリコール!電柱との衝突事故を受け」も参照。

2024年7月7日:百度の自動運転タクシーと電動バイクが衝突

中国では、武漢を走行中の百度の自動運転タクシーが2024年7月、電動バイクと衝突する事故が発生している。

百度のタクシーが左折する際、対向側から直進してきた電動バイクと衝突し、バイクの運転手が軽傷を負ったという。百度は「電動バイクが赤信号を無視した」としている。日本でいう右直事故だ。

現地メディアによると、武漢では同月、歩行者と接触する事故も発生しているようだ。こちらも歩行者が赤信号を無視していたという。

中国における事故の状況は表に出ないことが多いため、いまいち全体像がつかめず、Waymoとの比較もままならない。同国内でサービス展開する分にはそれで良いかもしれないが、今後グローバル展開を視野に収めるならば、信頼を得るためにもしっかりと情報公開する体制を整備しなければならないものと思われる。

2024年12月27日:自動運転車と配送ロボットが交差点で衝突

ロボット同士の接触事案もついに発生したようだ。Waymoの自動運転タクシーがロサンゼルスのウエストハリウッドを走行中、Serve Roboticsの自動配送ロボットと交差点で接触したという。

Serve Roboticsのロボットが交差点を横断し、歩道に乗り入れるため後退するなど軌道修正をしているところに右折してきたWaymo車が時速4マイル(約6.4キロメートル)で近づき、衝突直前に急ブレーキを作動させたものの間に合わなかったようだ。

双方とも特に損傷はなく、約1分間システムロックした後、それぞれ走行を再開したという。メディアの取材に対し、Waymoは自動配送ロボットを「無生物」として認識していたとしている。また、Serve Roboticsのロボットは、交差点横断時は遠隔監視下にあったという。

2025年1月19日:Waymo車が多重事故に巻き込まれ1人死亡

2025年1月、サンフランシスコでWaymoの自動運転タクシーを含む計7台が絡む多重事故が発生した。この事故で1人が亡くなったようだ。

信号待ちの車列に高速度を出した自動車が突っ込んだ模様で、巻き込まれた6台のうち1台がWaymoだった。乗客はおらず、車両後部が大破している。

2025年4月8日:Zoox車が乗用車と衝突

2025年後半にも自動運転タクシーサービスインを計画するZooxは2025年4月、試験車両でラスベガスを走行していたところ、前方に乗用車が急に車線変更してきた。減速して右車線に操舵したが、その乗用車も右車線に入って路肩車線に停車したため、ブレーキが間に合わず接触した。

2025年5月8日:交差点でZoox車がオートバイと接触

2025年5月には、サンフランシスコでZoox車がオートバイと接触する事故が発生した。Zooxの試験車両が低速で右左折中、交差点で優先権を譲るためブレーキをかけた電動スクーターに衝突されたという。接触時、Zoox車は停止していた。

4月の事故含めZoox側の過失は小さいものと思われるが、Zooxは都度事故の発生を公表するとともにリコールを実施するなど、誠実な対応を見せている。

【参考】Zooxの事故については「Amazonの自動運転車、「真横からの接近」に脆弱性 270台リコール」も参照。

2025年6月:テスラのロボタクシーが駐車場で接触

2025年6月22日にローンチしたばかりのテスラのロボタクシーだが、その数日後にさっそく接触事案を起こしたようだ。

テスラ車が駐車場で乗客を降ろした後、徐行状態で進行している際、左側に駐車中のクルマに寄っていきボディが接触してしまったようだ。

助手席にオペレーターが乗っていたが、手動介入したのかどうかを含め原因は不明だ。今のところ、この案件がテスラのロボタクシー初の接触事故と呼ばれている。

【参考】テスラのロボタクシーの事故については「テスラのロボタクシーが事故!お相手は「トヨタ車」」も参照。

2025年7月30日:Waymoの自動運転タクシー同士が衝突

Waymoの自動運転タクシーが接触する事案も発生したようだ。フェニックス・スカイハーバー国際空港で2025年7月、Waymoの車両同士が事故を起こし、その様子がSNSにアップされた。

1台のWaymo車の右前ドア付近にもう1台が後方斜めから突っ込んだような形だ。軽微な事故だが、実用化で先行するWaymoとしてはこの手の事案は回避したいところだろう。

【参考】関連記事としては「Googleのロボタクシー、「AI搭載同士」なのに衝突事故」も参照。

2025年8月6日:Baiduの自動運転タクシーが工事現場の穴に落下

中国では、百度(Baidu)の自動運転タクシーが工事用の溝に落ちるショッキングな事故が2025年8月に発生した。

経緯は不明だが、女性が乗車中のBaidu車が、道路脇の建設現場の大きな穴に落ちてしまったようだ。車両は横向きで穴にすっぽりと落ちている。乗客の女性は住民らにはしごを使って救助され、特にけがを負っていない。

現場には、バリケードや警告標識が設置されており、なぜBaidu車が落ちたのかは公式に明かされていない。

中国内における自動運転車の事故は情報が出回りにくく、多くが密室化している可能性がある。しかし、このケースのようにインパクトが強くSNSで一気に拡散されるものは隠し切れない時代になったようだ。

【参考】Baiduの事故については「中国の自動運転タクシーは、「工事中の穴」に落ちます」も参照。

2024年9月10日:Avrideの自動配送ロボットが自転車と衝突

Avrideの自動配送ロボットが、自転車と衝突する事故がオースティンで発生していたようだ。自転車の利用者は重傷を負い、その後Avrideを提訴したという。

自転車の利用者によると、自転車レーンを走行して優先権を持って交差点に進入した際、自動配送ロボットも交差点の横断を開始し、衝突したという。

訴訟の経過や結果は不明だが、衝突を防げなかった過失責任が問われているようだ。確かに、自動配送ロボットは歩行者よりも自転車との衝突の危険性の方が高いかもしれない。日本でも同様の事案が発生しないことを祈りたい。

2025年6月21日:香港国際空港で自動運転バス同士が衝突する事故

香港国際空港第1ターミナル近くの制限区域内で、自動運転バス同士が衝突する事故が発生したようだ。事故発生時、2台とも無人運行で乗客などもいなかった。

誘導路が交わる交差点で、一方は優先道路を走行していたが、もう一方の自動運転バスが停止を怠って交差点に進入し、衝突したという。

2025年9月14日:Waymo車に追突したオートバイドライバーが死亡

Waymoの自動運転タクシーが関連する死亡事故が2025年9月、アリゾナ州テンピで発生した。Waymo車に追突したオートバイが後続車と接触した事故だ。

自動運転タクシーが右折する際、歩行者を検知して停止したところ、後続車のオートバイがWaymo車に追突した。その直後、左車線の後続車がオートバイに接触して走り去ったという。オートバイのドライバーは病院に搬送されたが、その後死亡が確認された。

おそらくWaymo側に過失は見当たらず、もらい事故に相当する案件だ。

【参考】関連記事「Googleロボタクシーの死亡事故、実は「過失なし」の可能性」も参照。

2025年12月6日:ハローの自動運転タクシーが重傷事故

中国湖南省株洲市で、シェアサイクルなどを手掛けるハローの自動運転タクシーが歩行者2人をはねる重傷事故が発生した。車両はバイドゥ製の「Apollo RT6」のようだが、自動運転システムがアポロなのかハローオリジナルなのかは不明だ。

情報は錯綜しており、横断歩道を渡っていた歩行者2人がはねられたとする報道や、電動自転車で走行していて転倒したところに自動運転タクシーが通りかかり、車両の下に巻き込んだ――とする報道に二分されている。被害者のうち一人はヘルメットを着用していたとする情報もあり、後者の可能性が高そうだ。

後者と仮定した場合、目の前で急に倒れこんできたかどうかなども気になるところだ。転倒者を即座に認識したもののブレーキが間に合わなかったのか、あるいは認識が遅れた結果接触してしまったのか。この差は大きい。

自動運転車による中国初の重大事故とも言われているが、こうした負の情報が明るみになりづらい国だけに真相は定かではないが、SNS全盛の時代、完全に情報を隠すことが難しくなっているのは事実だ。

【参考】関連記事「アリババ出資の自動運転タクシー、中国で2人はね重体」も参照。

2026年1月23日:Waymoの自動運転タクシーが児童と接触

カリフォルニア州サンタモニカで、Waymoの自動運転タクシーが道路を横断しようとした子どもと接触する事故が発生した。子どもは軽傷で、車両と接触後、自ら立ち上がって歩道に移動したという。

現場は小学校付近で、子どもが自動車の陰から飛び出すような形で道路を横断しようとしたものと思われる。Waymoは、子どもを検知して即座に緊急ブレーキをかけ、時速約27キロから10キロ未満まで減速したと説明している。

子どもが飛び出してきたタイミングや速度などによるが、飛び出すかもしれないという予測と迅速な制御でどこまで事故を防ぐことができるか。また、どこまで防ぐべきなのか。100%を求めれば、少しでも怪しい場所はすべて徐行しなければならなくなり、円滑な道路交通に疑問符が付く。

自動運転は万能ではないため、許容すべきラインを明確にしなければならない日がいつか訪れることになりそうだ。

■国内での事例

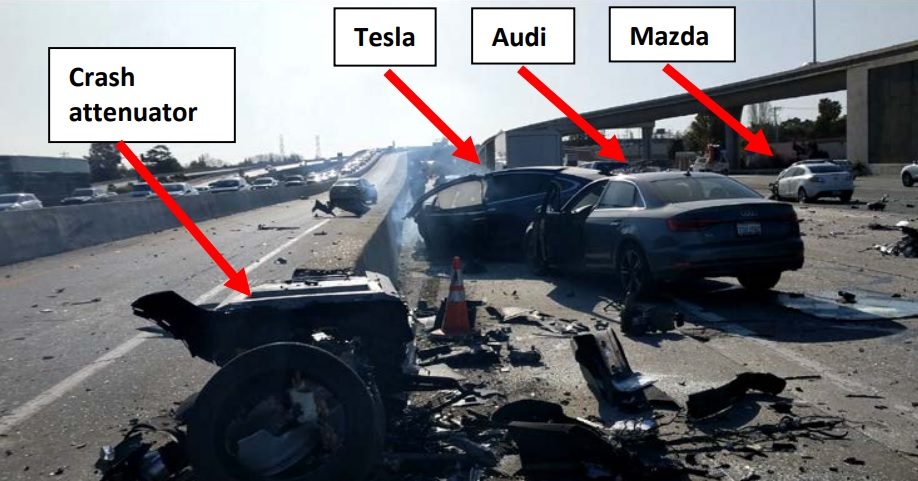

2019年8月26日:名古屋大学が所有する「ゆっくり自動運転」車両が接触事故

自動運転の実証実験を控えて試験走行していた名古屋大学所有の低速自動運転車が、2019年8月26日の午後2時20分ごろ、時速約14キロで市道を自動運転走行中に後ろから追い越してきた車両と接触した。この事故によるけが人などは出なかった。

試験走行には名古屋大学が所有する「ゆっくり自動運転」車両が使われており、一般車両が低速自動運転車両を右側から追い越そうとしたとき、低速自動運転車両が右側に寄ったことで衝突に至った。

事故の原因については事故検証委員会の報告書で触れられており、自動運転車両の位置・方位検知機能が進行すべき方位を誤検知したことが直接的な原因とされている。これによって誤った急操舵が生じたようだ。

報告書ではリスクアセスメント水準の低さや実験実施体制の不備などにも触れられており、再発防止策としては車両実験審査体制の強化などが挙げられた。

【参考】関連記事としては「豊田市の自動運転事故のなぜ 事故検証委の報告内容を考察」も参照。

2020年3月10日:BOLDLYの自動運転バスが都内で物損事故

ソフトバンク子会社のBOLDLY(2020年4月にSBドライブから社名変更)は2020年3月、自動運転バスの試験走行中に物損事故を起こしている。試験走行で使用されていたのは仏Navya社製の自律走行車両「NAVYA ARMA」で、東京・丸の内仲通りのバス停に停車する際、路上駐車の乗用車に接触した。この事故による負傷者はいなかった。

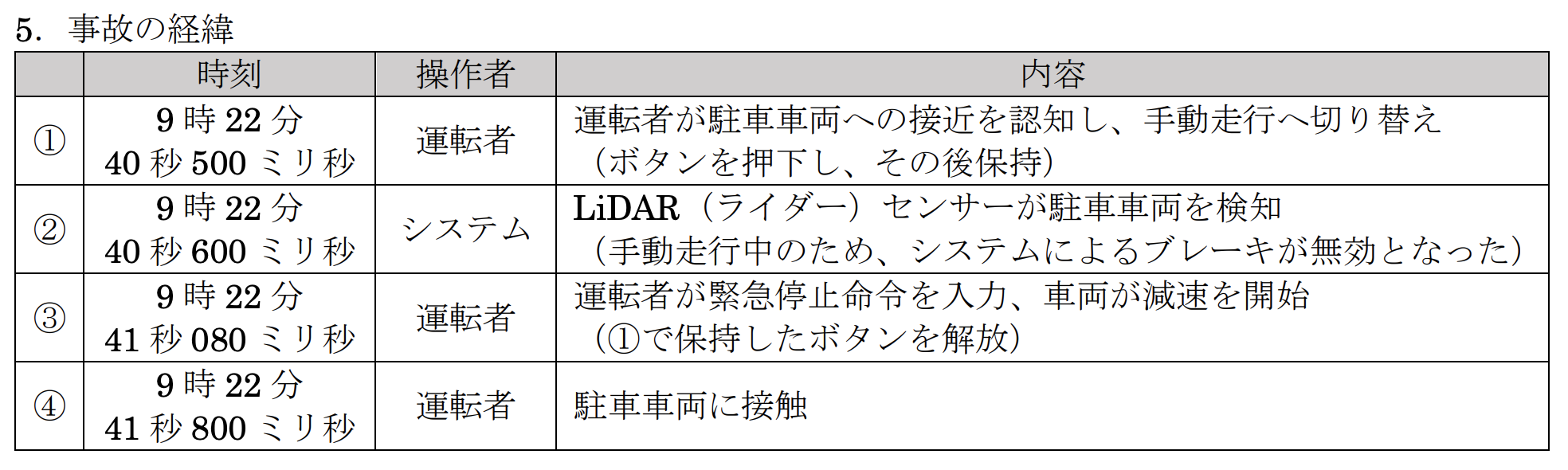

BOLDLYによると、自動走行中のバスを停車させる際に運転者は駐車車両への接近を認知し、手動走行への切り替えを行ない、これとほぼ同時に車両に搭載されたLiDARも駐車車両を検知したが、手動走行のためシステムによるブレーキが無効となった。

運転者は緊急停止命令を入力し、車両の減速が開始されたが間に合わず、駐車車両に接触したという。手動操作への切り替えから接触までは1.3秒だったという。

【参考】関連記事としては「ソフトバンク子会社の自動運転バス、都内で物損事故 手動走行へ切り替え後に」を参照。

2020年8月30日:産総研の実証実験で接触事案、運転手の判断ミスが要因

2020年8月に滋賀県大津市内で「産業技術総合研究所」(産総研)が行った中型自動運転バスの実証実験では、車両Uターンのために右旋回する際、車体左前のセンサーカバーが歩道柵の支柱部分に接触する事案が起きた。けが人はいなかった。

接触事案が発生した地点はやや特殊な形の丁字路で、転回中は極低速(時速4キロ以下)の自動運転を行なっていたが、転回が完了する前に歩道柵との間隔が狭くなると運転手が判断し、手動運転に切り替えた。運転手は自らの操作で転回するため前進したが、結果として歩道柵に接触したという。

この事案では、手動運転への移行のタイミングやGPSの精度、自動運転システムに異常は認められなかったとして、最終的に運転手の車幅感覚の判断ミスが要因とされた。

【参考】関連記事としては「接触8秒前に手動介入、運転手の判断ミスが要因 自動運転バスの接触事案」も参照。

2020年12月14日:再起動忘れが原因で自動運転バスがガードレールに接触

茨城県日立市内のひたちBRT路線で産総研が行った中型自動運転バスの実証実験で、2020年12月にガードレールと接触する事案が起きている。自動運転バスが時速30キロで直進区間を自動走行中、ハンドルが急旋回し、バスの右前方部分がガードレールに接触したというものだ。一般乗客は乗車しておらず、けが人はいなかったという。

ハンドルが急に切られた際、運転手は速やかに介入し手動制御したが間に合わなかったという。接触事案の原因は車両の位置推定機器の再起動忘れで、車両に搭載されているGNSS(衛星測位システム)方式と、磁気マーカー方式を用いる2つの機器が上手く切り替わらず、道路での車両の位置や方向に関する情報が更新されなかったことにより、ハンドルが急旋回したという。

この事案を受け、産総研は直接的な原因となった機器に再起動を促す表示を出すこと、自動運転システムによるハンドル操舵量の指示や制限を行うなどの対策を行うとしている。

【参考】関連記事としては「自動運転バスの接触事案、位置推定機器の再起動漏れが要因」も参照。

2021年8月26日:東京五輪の選手村でe-Paletteが接触事故

トヨタは東京五輪で自社開発の自動運転EV「e-Palette」を選手村で導入した。当初は事故が発生することなく、選手や大会関係者からも好評を得ていたが、2021年8月26日に視覚障害がある日本人選手と接触事故を起こし、運行を一時中断した。

事故現場は選手村内の交差点で、e-Paletteのセンサーが日本人選手を検知して車両が一時停止したが、オペレーターが安全確認をした上で車両を発進したあとで事故が起きた。詳細な事故原因については調査中だが、ヒューマンエラーによるものとみられている。

e-Paletteと接触した日本人選手は、頭や両足に全治2週間の軽傷を負った。事故当時はe-Paletteの車両にオペレーター2人と乗員5人がおり、自動運転レベルは「2」だったとされている。事故が起こった交差点には誘導員が2人配置されていたことも明らかになっている。

この事故でe-Paletteの運行は一時中断されたが、その後、交差点の誘導員を増やすなど対策を講じ、運行を再開することが決まっている。トヨタは五輪の終了まで改善を積み重ね、安全度のレベルアップを図るとしている。

▼東京2020オリンピック・パラリンピック競技大会選手村におけるe-Paletteと歩行者の接触について

https://global.toyota/jp/newsroom/corporate/35952442.html

2023年1月11日:大津市内で乗客が座席から滑り落ちる事故

2023年1月11日、滋賀県大津市内で2022年12月から実施中の自動運転バスの実証運行時に事故が発生した。 乗客が車内でけがをしたという事故だ。当時、ドライバーが運転席に座って安全を確保する「自動運転レベル2」の状態で走行していた。

1月時点では公式発表では詳細には触れられていないものの、新聞・テレビなどの報道によると、ホテル敷地内で前方の駐車車両を避けるため人間の運転手が手動でハンドルを切ったところ、前方の障害物がなくなったと判断した自動運転システムが車両を時速10キロまで急加速したものとみられ、その際に乗客が座席からすべり落ちたと考えられている。

大津市は事故後、以下の公式ページで事故について触れている。

▼令和4年度中心市街地における自動運転バスの実証実験について(現在、実験を中止しております)|大津市

https://www.city.otsu.lg.jp/soshiki/036/1801/g/kotsu/3485125.html

【参考】関連記事としては「自動運転、事故発生が再認識させる「人間くささ」の重要性」も参照。

2023年10月29日:「日本初のレベル4」で接触事故

福井県永平寺町の自動運転モビリティが2023年10月29日、人が乗っていない自転車と接触する事故を起こした。自動運転車に乗っていた70代の乗客4人にはケガは無かったが、安全対策が講じられるまで運行は停止されることになった。

この自動運転モビリティは、2023年4月に自動運転レベル4の水準で運行がスタートした。「日本初のレベル4」として大々的に報じられ、電磁誘導線を使った「誘導型」の自動運転ではあるものの、注目度は高かっただけに日本国内で波紋を広げた。

この自動運転モビリティのベース車両は、ヤマハ発動機の電動カート(7人乗り、区分は普通自動車)が使われている。車両に搭載されたセンサーが歩行者や障害物などを検知すると、自動で停車する仕組みで走行していた。

この事故の原因について2023年11月10日に発表が行われ、最も大きな要因の一つとなったのが、自動ブレーキを適切に作動させるための学習データが不足していることだと判明した。同時に、2024年3月から運行の再開を目指すことも明らかにされた。

【参考】関連記事としては「日本初レベル4の自動運転事故、「追加学習」で来年3月再開へ」も参照。

「日本初のレベル4」としてスタートした永平寺町の自動運転移動サービス。事故後に運行が停止されたが、無人の自転車の画像を追加学習させるなどし、来年3月からの再開を目指す。#自動運転

日本初レベル4の自動運転事故、「追加学習」で来年3月再開へ https://t.co/o0JTEZSYQF @jidountenlab

— 自動運転ラボ (@jidountenlab) November 14, 2023

2023年11月25日:福岡市内のロータリーで自動運転バスとタクシーが接触

福岡市東区箱崎地域で実証中の自動運転バスが、発車直後に後方から来たタクシーと接触する事故が発生した。けが人はいない。

実施主体はFUKUOKA Smart EASTモビリティ推進コンソーシアムで、BOLDLYの運行管理のもとMiCaによるレベル2走行を行っていた。

接触場所はロータリーで、自動運転バスが停車帯に設けられた乗降スポットから本線に合流する際、広報の確認が不十分なため本線を走行してきたタクシーに気付くのが遅れたようだ。

事故後、乗降スポットを約 7メートル後方にずらし、余裕をもって本線に合流できるよう走行経路の修正するなどし、12月8日に運行を再開した。

2024年1月17日:常滑市で自動運転バスがラバーポールに接触

愛知県常滑市で2024年1月、テスト走行中の自動運転バスが道路上にあるラバーポールに接触する事案が発生した。

アイサンテクノロジーやティアフォーらが実施する取り組みで、いすゞエルガを改造したモデルで試乗会に向けレベル2による試験走行を行っていたところ、ハンドル動作に異常が確認されたため運転手が手動運転に切り替えたが、道路中央のゴム製ポール1本に接触した。ポールには損はなく、擦った程度の接触事案だ。

安全性が確認されたことから、2月5日に公道走行を再開している。

2024年3月7日:千葉県横芝光町では手動運転中に遮断機に接触

ティアフォー製自動運転バスMinibusを導入する千葉県横芝光町では、同町とBOLDLY、京葉銀行が自動運転バスの通年運行事業を実施している。

国内では珍しくルート上に踏切があり、通過する際はレベル2で運行しているが、3月7日、手動運転中に踏切の一時停止線をわずかに越えてしまい、遮断機と車両前部が接触したという。人為的なミスだ。

自動運転車の多くは踏切を苦手としている。今回の事故は参考外だが、手動介入することなく安全に通過できるよう技術の向上に期待したいところだ。

【参考】関連記事としては「自動運転バスの事故、原因は「人間」 千葉県横芝光町で踏切遮断機と接触」も参照。

2024年3月27日:岐阜市で自動運転バスと路線バスが接触

岐阜市で2024年3月、国道を走行中の自動運転バスと前方に割り込んできた路線バスが接触する事案が発生した。車両はARMAで、BOLDLYが運行管理を担っている。

ARMAが第一車線を低速で走行中、第二車線を走行していた路線バスがARMAを追い抜き車線変更して前方に割り込んだ際、ARMAの右側面と路線バス左側後方が接触したという。負傷者はいなかった。

原因は、路線バス側の安全確認と車間距離の不足と判断され、自動運転システムに異常がない ことを確認できたため、4月3日に運行を再開している。

2024年6月11日/8月20日:弥彦村では物損事故が2回発生

BOLDLYがMiCaを運行している新潟県弥彦村では、2024年6月と8月に物損事故が起こった。公式発表が見当たらないが、同村と隣接売る燕市で定常運行中のMiCaが6月11日、道路脇に停車中の車両を追い越すため手動運転に切り替え、セーフティドライバーが運転していたところ、道路脇の電柱のワイヤーに引っ掛かり、センサーが破損した。けが人は出ていない。

8月20日には、走行中のMiCaが左側に逸れ、縁石に乗り上げる事案が発生した。こちらもけが人はいない。

事故発生の4秒前、オペレーターが操作用のタブレット端末に誤って触れてしまい、自動運転モードからニュートラルに切り替わったことが原因としている。

弥彦村の運行する自動運転バスは、2024年8月に縁石に乗り上げる自損事故を起こした。村の説明によれば、事故直前に自動運転機能が解除されており、その理由は、オペレーターがタブレット型の操作用端末に乗車中に誤って触れてしまったためのようだ。

同村では、操作機器の仕様を変更するなど対策し、10月に運行を再開している。

2024年10月10日:中津川市内を走行中の自動運転バスが停車車両のサイドミラーに接触

岐阜県中津川市内で自動運転実証中の自動運転バスが、対向車のドアミラーに接触する物損事故が発生した。乗客5人をはじめけが人は出ていない。実証はアイサンテクノロジーが委託していた。

自動運転バスが時速15キロで走行中、自動運転バスとのすれ違いのため停車していた対向車とサイドミラー同士が接触した。

自動運転システムは停車中の軽自動車の存在を検知していたが、自動運転車両が障害物を自動回避する走行範囲にその軽自動車は入っておらず、また、自動運転バスは、車両の特性や道路状況などにより事故直前は道路の右寄りを走行していたため、自動運転車両の一部が事前に設定している予定経路内での衝突判定領域から外れた状態だったとしている。

その状態で停車中の軽自動車に接近したため、セーフティドライバーが衝突を危惧して直前に手動介入したものの間に合わなかったようだ。

再発防止に向け、車両挙動の見直しと衝突判定領域の拡張などの対策、道の駅通路内などの閉鎖空間内で実車検証を行った上で、公道での再セッティング走行を再開するとしている。

2025年4月28日:万博駐車場待機場で回送中のシャトルバスが接触事故

開幕したばかりの大阪・関西万博で来場者を輸送する自動運転シャトルバスが、回送中にコンクリート擁壁に接触する事故が発生した。

車両はEVモーターズ・ジャパン製で、先進モビリティ製の自動運転システムを搭載したモデルと思われる。運行は大阪メトロが行っている。同区間では、同月2日に特定自動運行に係る許可を取得したばかりだった。

舞洲万博P&R駐車場の待機場においてドライバーが手動運転に切り替えて停車し、運転席を離れたところ、車両が自動で動き出し、擁壁に接触したという。けが人はいない。

事故原因については調査中で、大阪メトロは同型のシャトルバスによる自動運転運行を一時停止している。

【参考】万博×自動運転については「万博の自動運転バス、「車両も技術も国産」でレベル4認可を獲得」も参照。

2025年1月30日:熊本市でも自動運転バスに路線バスが接触

熊本市で2025年1月、左折時に一時停止した自動運転バスに路線バスが接触する事案が発生した。車両はティアフォー製 Minibus 2.0だ。

一般運行開始に向けレベル2で試験走行中、交差点を左折する際に歩道からはみ出た歩行者を検知したため、減速・停車したところ、後方を走行していた路線バスが接触した。負傷者はなかった。

自動運転システムに異常はなく、引き続き安全を考慮して停止行動をとるほか、自動運転の特性について現地看板や市HPなどで周知を図っていくとしている。

2025年3月6日:森之宮・京橋周遊バスが歩車道安全柵に接触

大阪メトロが大阪市内でサービス実証中の自動運転バスが2025年3月、交差点を左折する際に車両後部の側面を歩車道安全柵に接触させた。負傷者はいない。

大阪メトロと先進モビリティ、BOLDLYによる取り組みで、自動運転実現を目的にレベル2による森之宮・京橋周遊バスの公道走行を実施している。

事故が起こった交差点では、車載カメラで認識できない位置に信号機があるため、交差点に進入するまで運転士が信号を認識しながらアクセル介入していた。この日も、交差点に進入してからアクセルを解除して自動制御に切り替えたところ、左折先の横断歩道手前で歩行者を検知し減速した。

歩行者通過後に運転士が再度アクセル介入し左折を再開したが、自動運転時における設定速度と比較して速い速度だったため、軌道が設定ルートより左に寄って左折する形となり、運転士も咄嗟にハンドル介入したが車体後部左側面が歩車道安全柵に接触した。

こうした特殊な走行環境条件を踏まえた調整が完了するまでの間、同所では手動走行とするとともに運転士へアクセル介入すべきでない区間の周知徹底を再教育するとしている。

2025年7月21日:舞洲万博P&Rシャトルバスが縁石に接触

舞洲万博P&Rシャトルバスがレベル2で営業運行中、縁石に接触する事故が発生した。夢洲観光外周道路から夢舞大橋につながる夢洲北高架橋で、乗客7人にけがはなかった。

事故原因は調査中で、当該車両の運行を停止するとともに、営業運行中の同型車両3台については自動運転による運行を一時取りやめ、手動運転で運行を継続するとしている。

■カリフォルニア州における事故件数

カリフォルニア州道路管理局(DMV)は開発メーカーに対し、物的損害や身体傷害、または死亡につながる衝突があった場合、その事故発生後 10 日以内に報告する義務を課している。

衝突事故集計によると、2025年は4月までに31件報告されている。内訳はWaymo14件、Zoox13件、メルセデス・ベンツ、AutoX、May Mobility、Pony.ai各1件となっている。

2024年は105件報告されており、このうちWaymoが65件 Zoox25件WeRideとNuroが各4件、Pony.ai3件と続いている。Woven by Toyotaも1件報告されている。

2023年は133件報告されている。このうちWaymoが50件、Cruiseが41件となっている。Cruiseが撤退したため、2024年の総件数が減少したようだ。

軽微な事故が大半と思われるが、ニュースにならない事故もそれなりに発生していることがうかがえる。

2025年8月29日:八王子で自動運転バスが街路樹に衝突 乗客3人負傷

八王子で運行中の自動運転バスが2025年8月29日、街路樹に衝突する事故が発生した。乗客3人が軽傷を負い、国内における自動運転事故としては最大規模の人的被害となった。

東京都の事業で、日本工営が委託を受け、BOLDLYと西東京バスが再委託を受け自動運転バスのサービス実証を行っていた。使用車両はアルファバスジャパンの小型EVバス「E-City L6」で、自動運転システムの開発先は不明だ。

自動運転バスが高尾駅北口のバス停を出発し、国道20号をレベル2で時速20キロほどで走行していたところ、急に左側に車両が旋回し、時速10キロ程度で街路樹に衝突した。手動介入も間に合わなかったようだ。

調査の結果、自動運転システムの制御機能において、本来使用すべきではない古い目標位置情報を誤って読み込む設計上の不備が見つかった。車両がこの古い目標位置を参照して急ハンドルを行ったため、街路樹に衝突したという。制御機能から独立した衝突回避機能がなかった点も指摘されている。

改善策として、車両制御機能の情報に時刻を付けて管理し、データの常時照合を可能にして誤使用を防止することとした。また、システムが指示する急ハンドルの動作の角度や回転速度に上限を設けたほか、既存制御機能にタイヤの向きを考慮するなどの改良を加え、新たに独立した衝突回避システムを導入した。

【参考】関連記事「八王子で事故の自動運転バス、「中国製」って本当?」も参照。

2026年1月8日:埼玉県深谷市で自動運転バスが縁石に接触

埼玉県深谷市で実証運行中の自動運転バスが2026年1月8日、縁石に接触する事案が発生した。車両はティアフォー製の自動運転EVバス「Minibus v2.0」で、駐車中の緊急車両を避ける過程で縁石に接触したようだ。

自動運転バスがレベル2で走行中、深谷赤十字病院進入時の左折場所で前方に駐車中の救急車があり、この車両を回避する際、ハンドル操作能力の限界を超える操舵角の走行経路になったことでバス車両前方右下部が縁石に接触したという。バスには運転手含め7人が乗車していたが、けが人は出ていない。

走行可能エリアを越えた際に車両が自動停止する機能も備わっているが、過度な作動による快適性の低下を防ぐため無効化していたという。

また、手動運行への切り替えについてのルールや判断基準の文書化がなされておらず、運転手個人で判断していたため、手動運行への切り替えが遅れたとしている。

2026年1月15日:多良間村で自動運転バスが街路樹に衝突

沖縄県多良間村で2026年1月15日、県が実施している自動運転バス実証でバスが歩道に乗り上げ街路樹に衝突して停止する事故が発生した。

定期運行終了後、快適性向上のため乗客を乗せない状態で技術検証を行った際、自動運転機能の障害物検知システムをオフにしてレベル2で時速20キロで走行中、車両の挙動が不安定となり、歩道に乗り上げたという。けが人はいない。

原因の早期特定及び再発防止策を策定し、確定次第速やかに公表するとしている。

■【まとめ】さまざまな事案・事故が表面化

海外では、自動運転車に特段の過失はないものの死亡事故に関わる事例も出てきた。国内では、大半が軽い接触レベルの事案だが、軽傷者が出る事故も発生している。台数の増加に伴い、もらい事故を含めさまざまな事案・事故が表面化してきた印象だ。

あまり考えたくはないが、過失ありの死亡事故も遅かれ早かれ発生する。その際、自動運転の危険性を声高に評する動きが一時的に強くなり、世論が右へ左へと大きく振れそうだが、冷静に人間のドライバーと比較したうえで自動運転の安全性を評価し、交通イノベーションがおかしな方向へ向かわないよう注意したいところだ。

■関連FAQ

報道によると、2022年6月時点でアメリカで3件確認されている。テスラが2回、ウーバーが1回起こしているとされている。日本では死亡事故の事例はない。

実証実験が盛んになるにつれ、事例が増えてきた。もっとも注目を集めたのが、2021年に東京五輪の選手村でe-Paletteが選手と接触した事故だ。ヒューマンエラーが原因とされている。

少なくとも現時点では起きる。自動運転レベル5になれば運転の主体は完全にシステムとなるため、整備上・システム上の欠陥を除けば、「運転中のヒューマンエラー」という概念がほぼ無くなる。しかし、現時点の自動運転システムでは、人とシステムが協調しなければならないシーンが多く、ヒューマンエラーが起こり得る。

自動運転のレベルに合わせ、異なる結論となる。現在は各段階の事故の責任について議論が行われている状況で、すでに国の「自動運転に係る制度整備大綱」などで事故責任の考え方などが示されている。詳しくは「自動運転の事故、責任は誰が負う?」も参考にしてほしい。

自動運転タクシーや自動運転バス、そして市販車の自動運転車が少ない現在では、自動運転車の事故率を算出するのは困難だ。しかし将来的には事故率が算出され、手動運転の事故率と比較されるようになるはずだ。そうなれば「自動運転と手動運転、どちらが安全か」といった評価ができるようになる。

(初稿公開日:2018年4月29日/最終更新日:2026年3月11日)