米電気自動車(EV)大手テスラの自動車が2件の死亡事故を起こしている。いずれも同社の自動運転機能「オートパイロット」使用中に発生しているが、オートパイロットは安全運転支援システムであり、手放しやよそ見が許されるような自動運転システムではない。

こういった事故の原因には、「自動運転」と「運転支援」に関する定義や理解の問題が内包されているのではないか。その問題の重要性も再認識するため、テスラ車が起こした主な事故を参照し、改めて事故原因に迫ってみよう。

記事の目次

■テスラの過去の自動運転事故の事例

2016年5月7日:Model Sがトレーラー側面に衝突

2016年5月7日、オートパイロットを作動させた「Model S」のドライバーが米フロリダ州の中央分離帯のあるハイウェイ(幹線道路)を運転中、前を横切った大型トレーラーの側面に衝突し、死亡した。現場は信号のない交差点で、トレーラーが対向車線から交差点を左折中、側面にModel Sが突っ込んだという。

テスラは当初、事故の原因として日差しの強さを挙げ、白いトレーラーが日光を反射したことでシステムもドライバーもトレーラーを認識できなかったとする見解を発表していた。

しかし、国家運輸安全委員会(NTSB)の調査後の報告によると、ドライバーは事故当時「部分的な自動運転システム」を稼働していたが、ハンドルに手を添えていなければならない37分間のうち、わずか25秒間しか手で触っていなかったことが明らかになっている。システム側はドライバーに対し、ハンドルを握るよう警告を7回出していたという。

テスラはその後、2016年9月に警告にドライバーが反応しなかった場合は自動運転機能を使用不可にするなどの仕様変更を発表している。また、NTSBは車自体には欠陥がなかったと結論づけた。

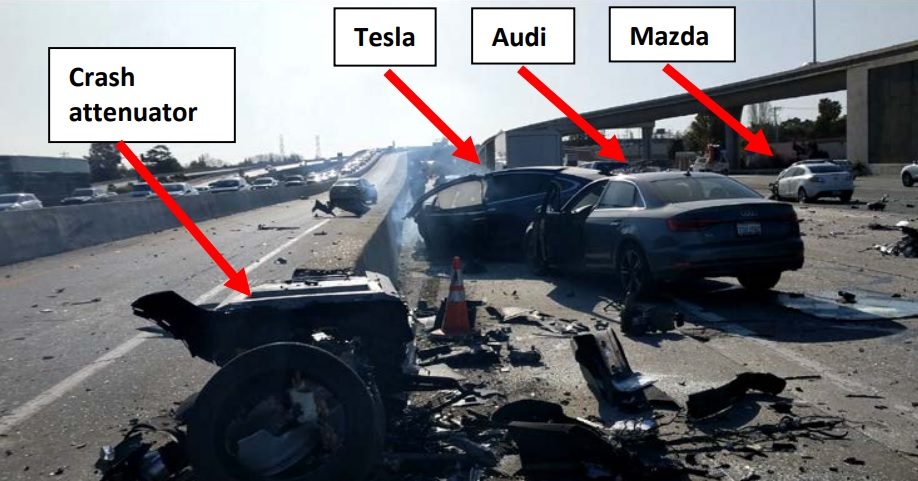

2018年3月23日:Model Xが高速道路で衝撃緩和用バリアに衝突し炎上

2018年3月23日、オートパイロットを作動させた「Model X」のドライバーが米西部カリフォルニア州の高速道路を運転中、中央分離帯に衝突・炎上し死亡した。

テスラの発表によると、事故は高速道路分岐点のコンクリート壁の前に置かれている衝撃緩和用バリアへの衝突で、衝突前の150メートルにわたり車線を外れて走行していたという。また、車線を外れていた約6秒の間、ドライバーはハンドルを握っていなかったとしている。

一方、死亡したドライバーの遺族は、過去に事故現場で何度もオートパイロットが車線を外れて中央分離帯の緩衝バリアへ向かって行きかけたことを主張し、オートパイロットの不具合を指摘している。

NTSBが同年6月に発表した予備調査結果によると、Model Xは衝突の18分55秒前にオートパイロットをオンにして、前走車両に追随して時速65マイル(約104キロ)で走行していた。衝突の15分前にはオートパイロットがハンドルを握るよう警告を発し、男性はそれに従ってハンドルを握っていた。その後もハンドル警告は3度発報され、その都度ドライバーはハンドルを握っていたという。

しかし、衝突の7秒前にオートパイロットがハンドルを左に切る動作を開始しており、衝突4秒前には完全に前走車両の追随から外れたと認識したため、クルーズコントロールの設定上限速度に向けて加速し始めた。衝突の6秒前に再度ハンドル警告が発生しているが、その際にハンドルを握ったというデータは残っていなかったという。

2018年1月22日:Model Sが消防車に追突

2018年1月22日、Model Sがオートパイロットでカリフォルニア州の幹線道路を走行中、前方に停車中の消防車に追突する事故が発生した。けが人はいなかった。

2018年5月29日:Model Sがパトカーに衝突

2018年5月29日、米カリフォルニア州で、道路脇に駐車中の警察パトカーにオートパイロット作動中のModel Sが衝突する事故が発生した。パトカーには誰も乗っておらず、ドライバーは軽傷だった。

報道などによると、事故現場はカリフォルニア州内のリゾート地であるラグーナビーチの公道。Model Sはパトカーの左側面に正面から衝突したとみられる。

【参考】関連記事としては「テスラ車、セミ自動運転モード中にパトカーと衝突 カリフォルニア州」も参照。

運転手は軽傷です テスラ車、セミ自動運転モード中にパトカーと衝突 カリフォルニア州 https://t.co/e0lT9T7rs2 @jidountenlabさんから

— 自動運転ラボ (@jidountenlab) May 30, 2018

■テスラの自動運転機能とADAS機能

現行車両には、標準安全機能として自動緊急ブレーキや正面衝突警報、側方衝突警告、オートハイビームなどが備えられており、オートパイロットシステムにより交通状況に応じてスピードを調整し、車線維持や自動で車線変更することが可能だ。

センサー類は8台のサラウンドカメラとアップデートされた12個の超音波センサーを搭載しており、360度の視界確保と最長250メートル先まで視認できるという。

最先端のプロセッシング技術が採用されたフォワードフェーシングレーダーはさらなる情報を認識し、豪雨や霧、塵、前方を走るクルマをも見通すことが可能で、これらのハードウェアから得られるすべてのデータを解析するため、前世代の40倍以上の処理能力を持つ新型車載コンピューターが管理を行っている。

全ての車両に人が運転するよりも安全性を大幅に向上することが可能な完全自動運転機能対応のハードウェアが搭載されており、ソフトウェアのアップデートにより最新の安全システムを入手できる仕組みを採用している。直近では、2018年10月26日にマスク氏が新機能となる「Navigate on Autopilot」の公開についてツイートしている。

この仕組みにより、将来的に完全自動運転が可能になり、運転席に座っている人によるアクションを一切必要とせずに、短距離・長距離ドライブが可能になるよう開発されているという。

ソフトウェアの配信は随時行っているが、高度な機能については検証が終了し、規制に関する承認が得られた後に段階的に実装される予定となっており、完全自動運転の実現は国や地域の状況にも左右されるため、正確な実現時期については断言していない。

【参考】Navigate on Autopilotについては「テスラのオートパイロットに新機能 運転支援「Navigate on Autopilot」公開へ」も参照。

テスラの運転支援機能、Navigate on Autopilot搭載で一層進化 米電気自動車大手 https://t.co/8aYahWrAS8 @jidountenlab #テスラ #イーロンマスク #ツイート

— 自動運転ラボ (@jidountenlab) November 1, 2018

■「自動運転」という言葉に対する啓発が必要

テスラをかばう気はないが、2件の死亡事故に共通しているのは、いずれのドライバーもハンドルから手を放し、システムから警告を受けていることだ。テスラ車に搭載されているのは現状自動運転レベル2相当のシステムであり、手放しで運転できるシステムではない。テスラも1件目の事故後に対策を講じている。

それでもなお手放し運転や不注意な運転が横行するのは、システムの過信によるところが大きいものと思われ、自動運転機能について過信させるような宣伝文句が使われていた可能性もある。2件目の死亡事故についてはシステムに不具合があったのか判然としない状況だが、ドライバーが「運転支援システム」と自覚していれば事故を防げた可能性は十分にあったはずだ。

日本では、国土交通省が2018年11月、自動運転レベル2までのシステムに対し「自動運転」という言葉を用いないよう各自動車メーカーと合意したことを発表した。自動運転という言葉をドライバーが誤解しないようにするための措置だ。

世間では「完全自動運転」や「部分自動運転」、「運転を支援する自動運転機能」などさまざまな言葉が使用されているが、絶対的な定義は存在せず、伝える側と受け手の感覚がずれていればそこに大きな誤解が生じる。

国土交通省の今回の合意と同様、世界標準として「自動運転」という言葉を再定義し、レベル2までを「運転支援レベル」に改定するなどわかりやすいものに置き換え、世界の全自動車メーカーが同一基準を用いることが求められるのではないだろうか。

【参考】関連記事としては「テスラの自動運転戦略や概要は? イーロン・マスク氏の経歴と人物像」も参照。

テスラを徹底解剖!自動運転やAI戦略の現状解説&まとめ イーロン・マスク氏、過去にトヨタ自動車と提携も|自動運転ラボ https://t.co/dD9LcPgFJd @jidountenlab #テスラ #イーロンマスク #まとめ

— 自動運転ラボ (@jidountenlab) September 20, 2018